- AIエージェントの定義と、従来のチャットボットとの決定的な違い

- マルチエージェントシステムの仕組み(オーケストレーション型・ピアツーピア型)

- 主要フレームワーク6種(LangGraph・CrewAI・OpenAI Agents SDK・Google ADK・Amazon Bedrock Agents・AutoGen)の特徴比較

- 導入企業の具体的な成果データ

- ハルシネーション・セキュリティ・ガバナンスの3大課題と対策

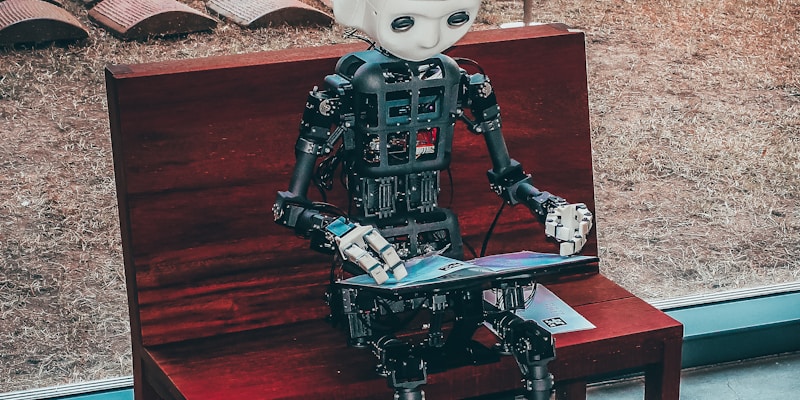

AIエージェントとは何か──「道具」から「パートナー」への転換

チャットボットとエージェントの決定的な違い

従来のAIチャットボットと、2026年に台頭しているAIエージェントの間には、本質的な設計思想の断絶がある。チャットボットは「人間が入力し、AIが出力する」という1往復の対話を繰り返す受動的な存在である。どれほど高性能なLLM(大規模言語モデル)を搭載していても、人間がプロンプトを打たなければ何も始まらない。

一方、AIエージェントは「目標を与えられたら、自ら計画を立て、必要なツールを選び、実行し、結果を評価して次のアクションを決定する」自律的なシステムである。たとえば「来月の営業レポートを作成して」と指示するだけで、CRMからデータを取得し、Excelで集計し、スライドにまとめ、関係者にメールで共有するまでを一貫して実行する。

この違いを端的に表すなら、チャットボットが「優秀な回答者」であるのに対し、エージェントは「自走する実行者」である。OpenAIのCEOサム・アルトマンが2025年に「2025年はAIエージェントが合流する年になる」と宣言し、実際に2026年はその言葉どおりの展開を見せている。

技術的に見ると、エージェントの自律性を支えているのは「ReAct(Reasoning + Acting)」と呼ばれるアーキテクチャである。LLMが思考(Reasoning)し、外部ツールを呼び出して行動(Acting)し、その結果を観察(Observation)して次の判断を下す。このループを人間の介入なしに繰り返すことで、複雑なタスクを完遂するのである。

エージェントを支える3つのコア技術

AIエージェントが自律的に動作するためには、3つの基盤技術が不可欠である。第一に「ツール呼び出し(Function Calling)」。LLMが外部のAPI、データベース、ファイルシステムなどを直接操作できる仕組みである。2024年にOpenAIが導入したFunction Callingが起点となり、2026年現在ではほぼすべての主要LLMプロバイダーがこの機能を標準搭載している。

第二に「メモリと状態管理」。エージェントが過去のやりとりや実行結果を記憶し、長期的なコンテキストを維持する技術である。短期メモリ(現在のタスクに関する情報)と長期メモリ(過去の実行履歴やユーザーの嗜好)を使い分けることで、継続的な業務遂行が可能になる。ベクトルデータベースを活用したRAG(検索拡張生成)もこの文脈で重要な役割を果たしている。

第三に「プランニング(計画立案)」。与えられた目標を複数のサブタスクに分解し、実行順序を決定する能力である。Chain-of-Thought(思考連鎖)推論の進化により、LLMは複雑な問題を段階的に分解して解決できるようになった。2026年のエージェントは、タスクの依存関係を分析し、並列実行可能なステップを特定して効率的に処理する。

これら3つの技術が組み合わさることで、AIエージェントは単なる「賢いチャットボット」から「業務プロセスを自律的に遂行するシステム」へと進化した。特にFunction Callingの標準化は、エージェントが現実世界のシステムと接続するための共通言語を提供し、エコシステム全体の発展を加速させている。

市場規模が示す爆発的な成長曲線

AIエージェント市場の成長速度は、テクノロジー業界の中でも異例である。Fortune Business Insightsによれば、グローバルのAIエージェント市場は2026年に約118億ドル(約1.7兆円)に達し、2034年には2,514億ドル(約37兆円)へ拡大する見通しである。Grand View Researchの別の予測では、2030年に503億ドル規模となり、年平均成長率(CAGR)は45.8%という驚異的な数値を示している。

日本国内に目を向けると、国内AIエージェント基盤市場は2024年度の1.6億円から2029年度には135億円規模へ拡大すると予測されている。5年間で80倍以上の成長率であり、2026年はPoCフェーズから本番導入への移行期にあたる。伊藤忠テクノソリューションズ(CTC)は2026年度末までに、生成AIを含む高度AIビジネスで500億円の売上を目標に掲げており、マルチAIエージェント構築支援サービスも開始している。

ただし、楽観論だけではない。Gartnerは「2027年末までにエージェンティックAIプロジェクトの40%以上が中止される」とも予測している。コストの肥大化、ビジネス価値の不透明さ、リスク管理の不備がその理由である。市場は急拡大しているが、成功と失敗の明暗がはっきり分かれる段階に入っている。

あわせて読みたい

マルチエージェントの仕組み──なぜ「1体」では足りないのか

オーケストレーション型とピアツーピア型

マルチエージェントシステム(MAS)とは、複数の専門化されたAIエージェントが協調して複雑なタスクを遂行するアーキテクチャである。Gartnerが2026年の戦略的テクノロジートレンドの1つに挙げたこの概念は、単体エージェントの限界を超えるために設計されている。

MASの設計パターンは大きく2つに分類される。第一が「オーケストレーション型(スーパーバイザー型)」である。1体の管理エージェント(スーパーバイザー)が司令塔となり、タスクを分解して専門エージェントに割り振り、結果を統合する。Amazon Bedrock Agentsのマルチエージェント協調機能はこの方式を採用しており、スーパーバイザーエージェントがサブエージェントに対して並列または逐次的にタスクを委譲する。

第二が「ピアツーピア型(分散型)」である。各エージェントが対等な立場で相互にメッセージを交換し、合議的に問題を解決する。AutoGen(現AG2)の会話パターンがこの代表例であり、複数のエージェントがグループディスカッション形式で推論を進める。この方式は、正解が1つに定まらない創造的なタスクや、多角的な分析が必要な場面に適している。

実際の本番環境では、両方のパターンを組み合わせた「ハイブリッド型」が主流になりつつある。CrewAIはシーケンシャル、階層型、ハイブリッドの3つのオーケストレーションモードを提供しており、タスクの性質に応じて使い分けられる設計になっている。

実務で動くマルチエージェントの具体例

マルチエージェントシステムは、すでに複数の業界で実務レベルの成果を出し始めている。NTTデータは生成AIとマルチエージェント技術を融合させた「LITRON」シリーズを開発した。JALカードとの実証実験では、AIバーチャル顧客同士のディスカッションから得られた洞察をもとにDM施策を実施し、購買率が従来比3.0%向上するという成果を出している(NTTデータ、2024年7月発表)。さらに2025年6月に提供を開始した「LITRON Marketing」により、マーケティング全体のプロセスで最大60%の業務負荷削減が見込まれている。

ソフトバンクはセイノー情報サービスと共同で、物流業界特化型AIエージェント「ロジスティクス・エージェント」のMVPモデルを構築した。倉庫管理システム「SLIMS」にエージェント機能を組み込み、物流現場の状況把握から判断・行動までをAIが支援する。同社の試算では、対象業務の作業時間を最大80%削減できる見通しである(セイノー情報サービス公式サイトより)。

ソフトウェア開発の現場でも、マルチエージェントの活用が進んでいる。たとえば、1体目のエージェントがコードを生成し、2体目がコードレビューを実施し、3体目がテストケースを作成して実行するという分業体制である。Anthropicが提供するClaude Codeでは、複数のサブエージェントが並列で調査・実装・検証を行うワークフローが実際に機能している。

inovawayのレポートによれば、マルチエージェントAIの導入企業は2025年比で45%速い成果達成、60%高い精度、20〜70%のオペレーションコスト削減を実現しているという。これらの数字は、マルチエージェントが単なる技術的な好奇心ではなく、実測可能なROIを生む段階に入ったことを示している。

A2A・MCPが切り拓く相互運用の未来

マルチエージェントシステムの普及を阻む最大のボトルネックは「相互運用性」であった。異なるフレームワークで構築されたエージェント同士が連携できなければ、企業は特定のベンダーに縛られることになる。この課題を解決するために、2つのオープンプロトコルが急速に標準化を進めている。

第一が「MCP(Model Context Protocol)」である。Anthropicが2024年に提唱したこのプロトコルは、AIエージェントが外部のツールやデータソースに統一的なインターフェースでアクセスするための規格である。2026年現在、Microsoft Copilot Studio、Google ADK、Amazon Bedrock AgentCoreなど主要プラットフォームがMCPのサポートを表明しており、事実上の業界標準となりつつある。

第二が「A2A(Agent-to-Agent Protocol)」である。Googleが2025年に発表したこのプロトコルは、異なるフレームワークで構築されたエージェント同士が直接通信するための仕様である。MCPがエージェントとツールの接続を標準化するのに対し、A2Aはエージェント間の通信を標準化する。Amazon Bedrock AgentCore RuntimeもA2Aプロトコルのサポートを導入しており、クラウドプロバイダー間でのエージェント連携が現実味を帯びている。

MCPとA2Aの組み合わせにより、「Googleのエージェントが作成したデータを、Microsoftのエージェントが処理し、AWSのエージェントがデプロイする」といったクロスプラットフォーム連携が技術的に可能になりつつある。2026年はこれらのプロトコルが実装フェーズに入った転換点として記憶されるだろう。

主要フレームワーク徹底比較──どれを選ぶべきか

2026年現在、マルチエージェントシステムを構築するためのフレームワークは乱立状態にある。StackOneの調査では、120以上のエージェンティックAIツールが11カテゴリにわたって存在する。ここでは、実務で採用実績の多い主要5フレームワークを比較する。

| フレームワーク | 提供元 | GitHub Stars | アーキテクチャ | 最適な用途 |

|---|---|---|---|---|

| LangGraph | LangChain | 25,000 | グラフベース状態機械 | 複雑な本番ワークフロー |

| CrewAI | CrewAI Inc. | 44,600 | ロールベースチーム | 高速プロトタイピング |

| OpenAI Agents SDK | OpenAI | 19,100 | 5プリミティブ方式 | OpenAIモデル活用 |

| Google ADK | 18,000 | モジュラーワークフロー | マルチ言語チーム | |

| Bedrock Agents | AWS | マネージド | スーパーバイザー型 | AWSエンタープライズ |

LangGraph

LangGraphは、LangChainチームが開発したグラフベースのエージェントフレームワークであり、2026年時点でエンタープライズ採用数において最も多い検索ボリューム(月間27,100件)を誇る。エージェントをノード、遷移をエッジ、共有データをステートとしてモデル化する「状態機械」アプローチが最大の特徴である。

この設計により、開発者はエージェントの振る舞いを明示的に制御できる。条件分岐、ループ、人間による承認ステップ(Human-in-the-Loop)を宣言的に定義でき、本番環境で求められる「予測可能性」と「デバッグ容易性」を両立している。併設のLangSmithは最も充実したオブザーバビリティツールであり、ノードごとのトークン消費量、実行時間、エラー発生箇所をトレースできる。

一方、学習コストの高さが課題である。グラフ理論の基礎知識が前提となるため、LangChainエコシステムに不慣れなチームには立ち上がりが遅くなる傾向がある。本番環境での複雑なワークフロー構築には最適だが、小規模なPoCには過剰設計になるケースもある。

料金体系は、フレームワーク自体は無料(OSS)であり、オブザーバビリティ基盤のLangSmith Plusが月額39ドル/席となっている。

CrewAI

CrewAIは、GitHub Stars 44,600と全フレームワーク中最多のコミュニティ支持を集めるロールベースのマルチエージェントフレームワークである。「クルー(チーム)」にエージェントを配置し、各エージェントに役割と目標を与えるだけで、チーム全体が協調してタスクを遂行する。

最大の強みは「Time-to-Production(本番投入までの速さ)」である。LangGraphと比較して、標準的なビジネスワークフローの構築が約40%速いというデータがある。ビジュアルエディタ「CrewAI Studio」を使えば、コードを書かずにエージェントチームを設計・テストできる。Gmail、Slack、Webhookなどのトリガーも標準サポートしている。

弱点は、内部動作のブラックボックス性である。エージェントの判断ロジックが抽象化されているため、トラブルシューティング時に「なぜこのエージェントがこの判断をしたのか」を追跡しにくい。LangGraphのような明示的なステート管理がないため、複雑なエッジケースの制御に限界がある。

ラピッドプロトタイピングやビジネスプロセスの自動化には圧倒的に強く、「まずマルチエージェントを試してみたい」というチームに最適である。

OpenAI Agents SDK

OpenAI Agents SDKは、5つのプリミティブ(Agents、Handoffs、Guardrails、Sessions、Tracing)でエージェントを構築する、ミニマルで洗練されたフレームワークである。Web検索、ファイル検索、コンピュータ操作がファーストクラスのツールとして組み込まれている点が特徴的である。

OpenAIモデルとのネイティブ統合が最大の利点であり、GPT-4oやo3といった最新モデルの性能をフルに引き出せる。APIの設計もOpenAIの他のプロダクトと一貫しており、すでにOpenAIエコシステムを利用しているチームにとっては学習コストが極めて低い。

課題はベンダーロックインである。OpenAIモデル以外のLLM(Claude、Geminiなど)との連携は設計上の優先事項ではなく、マルチモデル戦略を採るチームにとっては制約となる。しかし、OpenAIに絞った開発であれば、最もスムーズなDX(開発者体験)を提供するフレームワークである。

GitHub Stars 19,100は後発にもかかわらず急成長を示しており、OpenAIブランドの求心力がコミュニティ拡大を牽引している。

Google ADK(Agent Development Kit)

Google ADKは、Googleが公式に提供するエージェント開発キットであり、Vertex AIやGemini APIとのシームレスな統合を前提に設計されている。最大の差別化要因は「マルチ言語サポート」であり、Python、TypeScript、Go、Javaの4言語に対応している。JVMやGoのバックエンドを持つエンタープライズチームにとって、これは他のフレームワークにない強力な利点である。

アーキテクチャ面では、Sequential Agent、Parallel Agent、Loop Agentといったモジュラーなワークフローエージェントと、LLMが動的にルーティングを決定するLLM Agentを組み合わせることができる。内蔵の評価フレームワークにより、エージェントの出力品質を定量的に測定できる点も実用的である。

モデルアグノスティック(特定モデルに依存しない)設計を謳っており、Geminiだけでなく他のLLMも利用可能である。ただし、2026年4月時点では各言語SDKの成熟度にばらつきがあり、Pythonが最も安定している。Go・Java SDKは急速に改善されているものの、Pythonほどの完成度には至っていない。

Google Workspaceとの統合、A2AプロトコルのネイティブサポートなどGoogleエコシステムとの親和性が高く、Google Cloud Platform(GCP)を基盤とする企業に特に適している。

Amazon Bedrock Agents

Amazon Bedrock Agentsは、AWSが提供するフルマネージドのエージェントサービスであり、他のOSSフレームワークとは異なりインフラ管理が不要である。自然言語でタスクを記述するだけでエージェントが自動構築され、IAM/VPC統合、Bedrock Guardrails、HIPAA準拠などエンタープライズグレードのセキュリティが最初から組み込まれている。

2026年に入り、マルチエージェント協調機能がGA(一般提供)となった。スーパーバイザーエージェントが複数のサブエージェントを統括し、並列処理や逐次処理を自動で管理する。さらにBedrock AgentCoreではA2Aプロトコルのサポートも導入されており、AWS外のエージェントとの連携も視野に入っている。

最大のメリットは「運用負荷の低さ」である。スケーリング、モニタリング、セキュリティパッチの適用をAWSが管理するため、開発チームはビジネスロジックに集中できる。一方、フレームワーク型に比べてカスタマイズの柔軟性は制限される。実験的なアーキテクチャの探索や、細かいエージェント動作の制御には不向きである。

AWSのエコシステム(S3、DynamoDB、Lambda、SageMaker)との統合が最大の強みであり、既存のAWSインフラ上にエージェントを展開したい大企業に最適な選択肢である。

立ちはだかる3つの壁──ハルシネーション・セキュリティ・ガバナンス

幻覚リスクと品質保証の限界

AIエージェントが自律的に行動する以上、その出力に「ハルシネーション(幻覚)」が含まれるリスクは避けられない。チャットボットのハルシネーションは「誤った回答を表示する」だけで済むが、エージェントのハルシネーションは「誤った判断に基づいて実際のシステムを操作する」という実害に直結する。

たとえば、営業データを分析するエージェントが存在しないレコードを「発見」し、それに基づいてレポートを作成した場合、経営判断が歪められる。物流エージェントが誤った在庫数を前提に発注を実行すれば、過剰在庫や欠品が発生する。エージェントの幻覚は、チャットボットの幻覚とは比較にならないビジネスインパクトを持つ。

対策として、Bedrock GuardrailsやOpenAI Agents SDKのGuardrailsプリミティブなど、エージェントの出力を検証するレイヤーの実装が標準的になりつつある。しかし、ガードレールの設計自体にもLLMを使う以上、完全な排除は不可能である。「エージェントの出力を人間が最終承認するHuman-in-the-Loop設計」が、2026年時点での最も現実的な品質保証手法である。

Google ADKが内蔵する評価フレームワークのように、エージェントの出力品質を定量的にモニタリングし、品質劣化を自動検知する仕組みも重要である。本番運用では「エージェントを信頼する」のではなく「エージェントを継続的に検証する」姿勢が求められる。

エージェント・スプロール問題

2026年、企業が直面している新たな脅威が「エージェント・スプロール(野良エージェントの増殖)」である。Zenityの2026年脅威レポートによれば、80%の企業がライブエージェントからリスクのある行動を報告しており、全エージェントの半数以上がセキュリティ監視やログ記録なしで稼働しているという。

問題の根本は、エージェント構築の民主化にある。ノーコードツールの普及により、IT部門の管理外で業務部門が独自にエージェントを作成するケースが急増している。これらの「シャドーエージェント」は、社内の機密データにアクセスする権限を持ちながら、セキュリティポリシーの適用外で動作する。AGAT Softwareの調査では、どのAIエージェントが互いに通信しているかを完全に把握できている組織はわずか24.4%にとどまる。

エージェント・スプロールへの対策として、Arthurなどが提供する「エージェント・ディスカバリー・プラットフォーム」が登場している。組織内で稼働するすべてのエージェントを自動的に検出し、インベントリ化し、リスクスコアを付与するソリューションである。エージェントの数が増えるほど、この「可視化」のレイヤーが不可欠になる。

RPAの時代に「野良ロボット」が問題になったように、AIエージェントの時代には「野良エージェント」が同様の、あるいはそれ以上の脅威となる。エージェントはRPAロボットよりも自律性が高い分、制御不能になった場合の被害も大きい。

規制と人間の監督をどう設計するか

AIエージェントのガバナンス設計は、2026年の企業にとって最も困難な課題の1つである。Aonのレポートによれば、82%の経営層が「既存のポリシーでAIエージェントのリスクを管理できている」と回答しているが、実際のセキュリティコントロールとの間には大きなギャップがある。「経営層の自信」と「現場の実態」の乖離が、エージェントAIセキュリティにおける2026年の本質的な問題であるとAGAT Softwareは指摘している。

EU AI Act(2024年発効)は、AIシステムをリスクレベルに応じて分類し、高リスクシステムには人間の監督を義務付けている。AIエージェントが自律的に意思決定を行う場合、多くのケースで「高リスク」に分類される可能性がある。日本でも、2024年にAI事業者ガイドラインが策定され、透明性確保と説明責任が求められている。

実務的なガバナンス設計の鍵は「段階的な自律性」である。すべてのタスクを最初からエージェントに任せるのではなく、リスクの低いタスクから自動化を始め、実績に応じて自律範囲を拡大する。大和総研の坂本博勝氏は、「ニューロシンボリックAI」というアプローチ、つまりAIの判断に要所でルールベースの制約を組み合わせる手法が、2026年に広く採用される方向性だと指摘している。

最終的に重要なのは、AIエージェントを「人間の代替」ではなく「人間の能力拡張」として位置づける姿勢である。Salesforceの2026年年頭所感では「人とAIエージェントが協働する社会の実現」を掲げており、人間の監督を前提としたエージェント設計が主流になりつつある。

まとめ──タイプ別おすすめマルチエージェントフレームワーク

2026年は、AIが「生成する道具」から「自律的に行動するパートナー」へ転換する元年となった。マルチエージェントシステムは、単体エージェントの限界を超え、企業のDXを根本から変えるポテンシャルを持っている。一方で、ハルシネーション、セキュリティ、ガバナンスという3つの課題を直視し、「段階的な自律性」の設計が不可欠である。

以下に、チームのタイプ別に最適なフレームワークを整理する。

| チームタイプ | おすすめ | 理由 |

|---|---|---|

| 本番運用重視の大規模チーム | LangGraph | 状態管理・オブザーバビリティが最も充実 |

| まず試したいスタートアップ | CrewAI | 学習コスト最小、本番投入まで最速 |

| OpenAI統一のチーム | OpenAI Agents SDK | GPT-4o/o3との統合が最もスムーズ |

| Go/Java中心のエンタープライズ | Google ADK | 唯一の本格マルチ言語対応 |

| AWS基盤の大企業 | Bedrock Agents | インフラ管理不要、HIPAA準拠 |

| 研究・実験目的 | AutoGen(AG2) | 会話型マルチエージェントの実験に最適 |

マルチエージェントの世界は、MCP・A2Aというオープンプロトコルの普及により「どのフレームワークを選んでも相互運用できる」未来に向かっている。重要なのは、フレームワーク選定に時間をかけすぎることではなく、小さく始めて実際の業務課題で検証し、成果を積み上げることである。「AIエージェント元年」の波に乗るための第一歩は、まず手を動かすところから始まる。